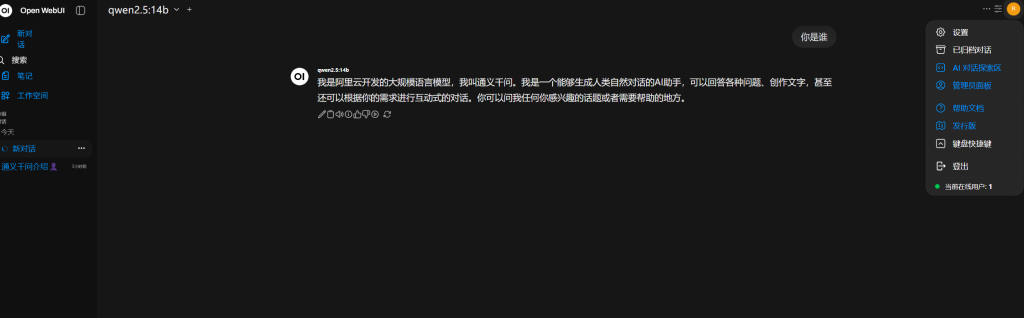

1.部署工具Open WebUI

直接docker部署

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/app/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main2.下载模型工具Ollama

转移安装目录:所在安装包文件下cmd以下命令

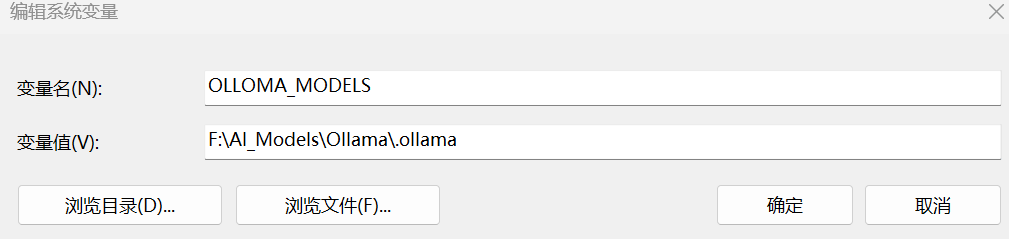

OllamaSetup.exe /DIR=F:\AI_Models\Ollama设置系统环境变量

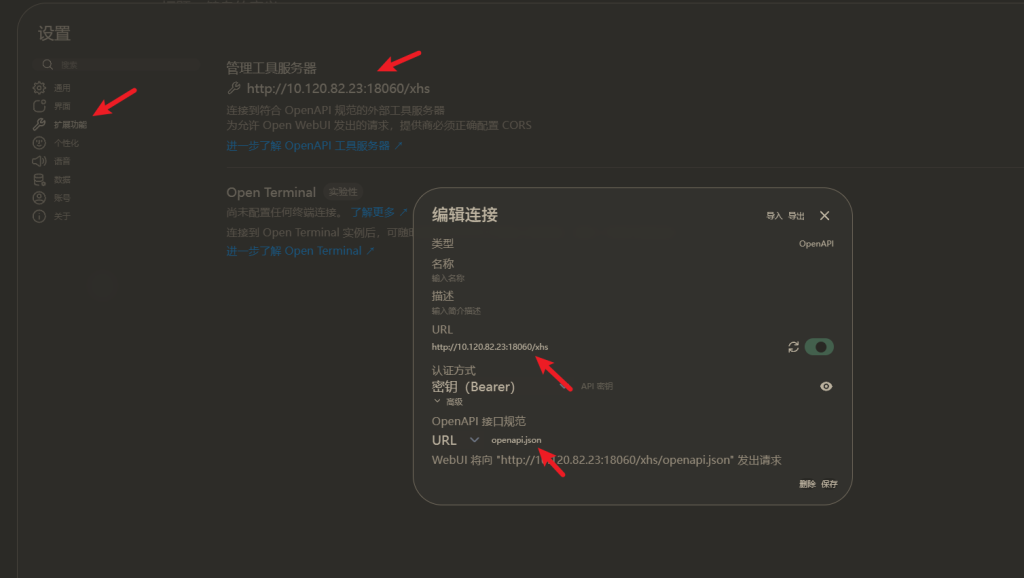

3.连接mcp -> 小红书

原理:

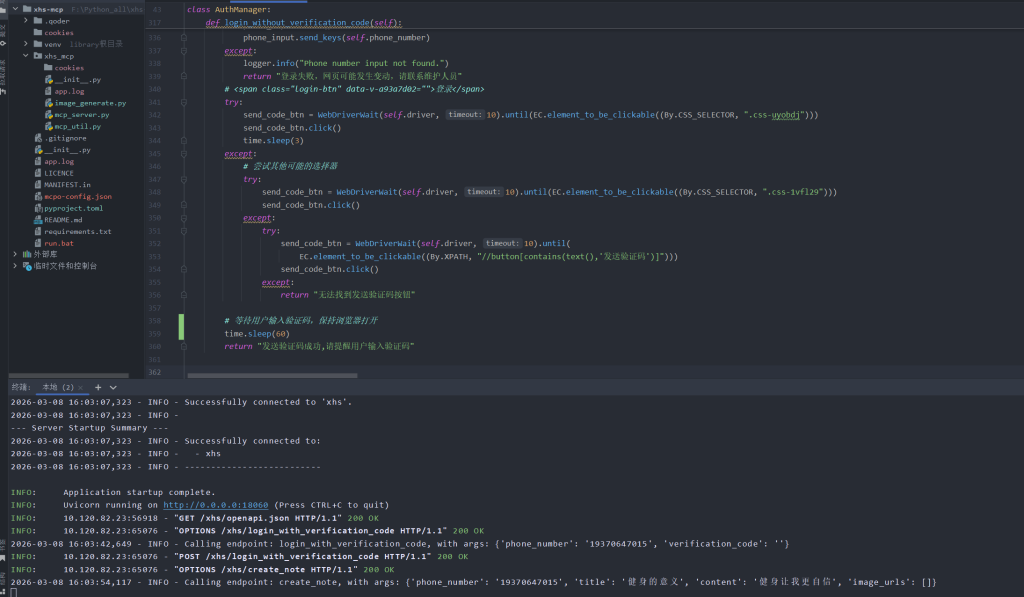

一个小红书的 MCP 服务器,支持通过对话的方式进行账号登陆、文案生成、以及自动发布。相比于已有的实现,优势在于登陆账号以及文案发布全部可以在对话过程中自动实现,并能支持多个账号批量发布文案。使用浏览器模拟的方式,通过 Chrome 驱动启动浏览器,来自动进行账号登录(会发送验证码到手机上),以及发布文案。登录后,会将 Cookie 保存下来,之后发布文章就不再需要重新登录了。

大白话叙述:自动化流程。弊端也会出现,随着各种软件平台更新迭代,各种工具也会出来,维护成本稍大,所以关注开源工具即可,不必死磕,哪种好用用哪个。

小红书的mcp在开源可以找到很多,可以本地部署的。

- THE END -

最后修改:2026年3月8日

共有 0 条评论