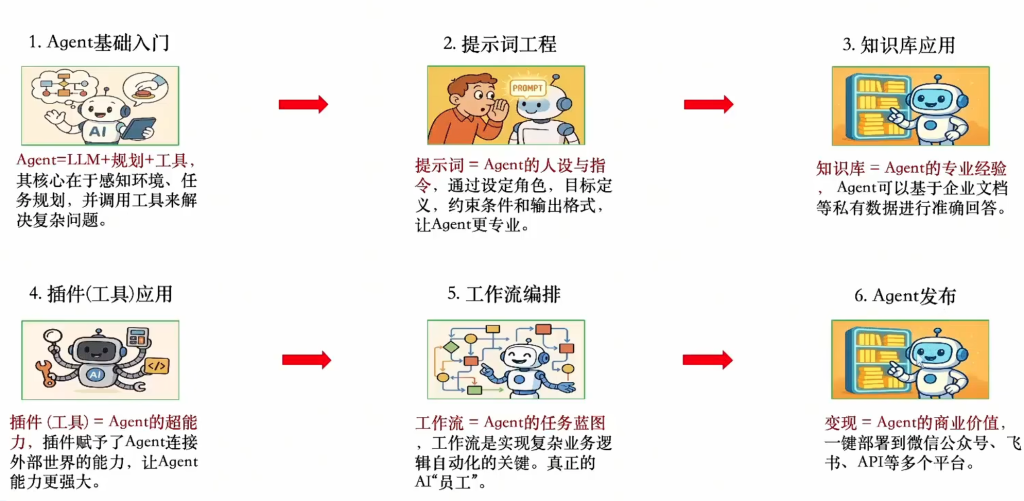

RAG: 检索增强生成

企业应用:企业知识库、客服机器人、文档助手

一、为什么需要RAG

LLM:预测下一个token(词元)

- 幻觉

- 知识过时

- 私有数据

如果把整个文档给交LLM,会出现上下文窗口问题、成本问题、响应速度

二、RAG核心流程

1.数据准备

私有文档切分(chunking,章节/段落/字数) ------> 每一块相对完整 ------> embedding向量化 ------> 文本、向量存储

2.用户提问

用户:query? ------> embedding向量化 ------> 混合检索(关键词检索+相似度检索(余弦cos))------> 召回Top-k(粗排)------> rerank 重排 -------> prompt(query? + rerank k + 提示词) ------> LLM(生成答案)

3.卡点及优化技巧

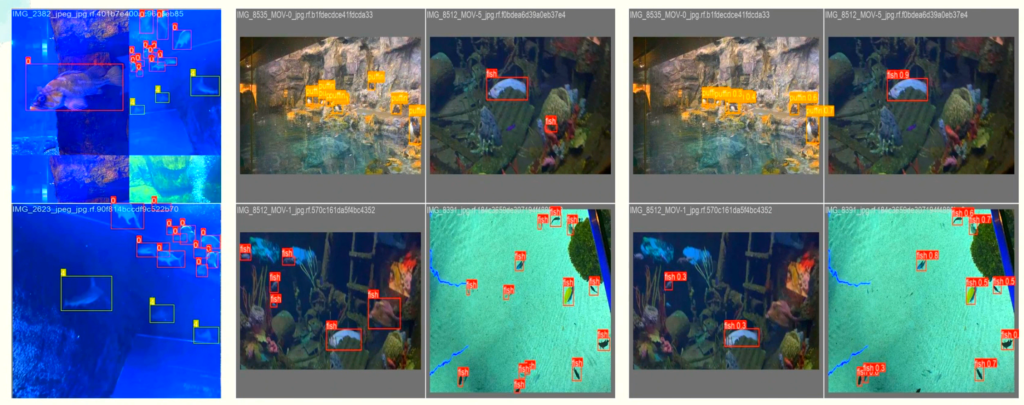

- 解析:pdf、表格、图片 - 数据清洗 + OCR

- 切分问题: 块太大不准确、块太小语义断裂 - 场景+具体分析

- query:问题模糊 - 问题重写

- 基座模型:部署开源模型-数据安全,较好模型

- THE END -

最后修改:2026年5月6日

非特殊说明,本博所有文章均为博主原创。

如若转载,请注明出处:https://blog.grover.top/2025/11/06/rag%e4%bc%81%e4%b8%9a%e8%90%bd%e5%9c%b0%e5%ad%a6%e4%b9%a0/

共有 0 条评论