前言

SFT: 监督学习,解决的是对不对的问题。

RLHF: 强化学习,解决的是能不能安全做对的问题。

DPO:直接优化偏好,解决的是如何又快又好的做到的问题

目前格局:80%场景用 SFT + DPO,20% 高安全场景用 RLHF

一、项目背景

需求一:

AI电商类目生成项目因文本大模型生成文本太单一,故需微调开源模型部署

二、环境准备

1.AutoDl租卡

AutoDL算力云 | 弹性、好用、省钱,GPU算力零售价格新标杆

2.vscode remote远程连接ssh

3.数据集 ModelScope :

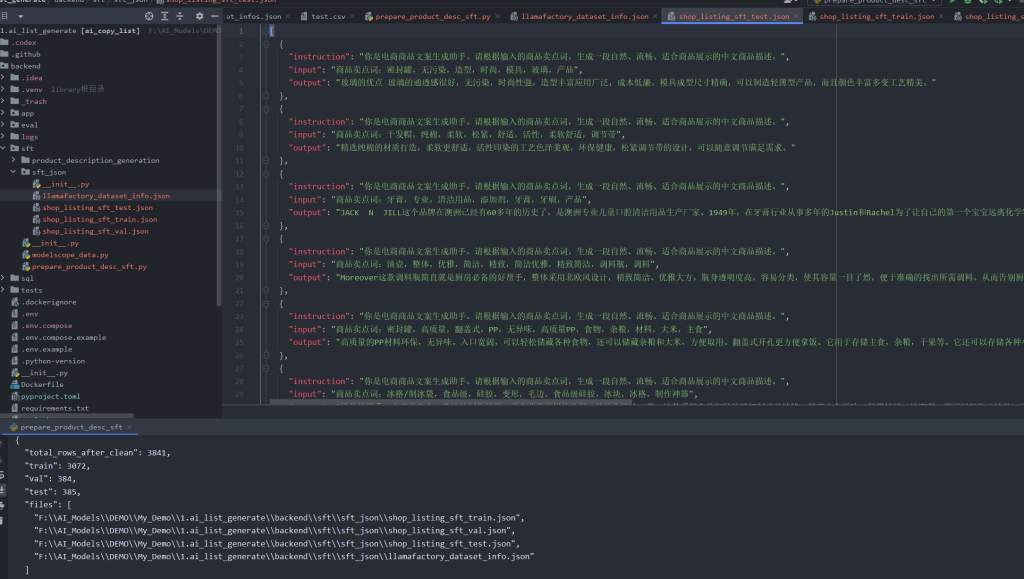

git clone https://www.modelscope.cn/datasets/haiyang/product_description_generation.git数据清洗:训练集/验证集/测试集 为8 : 1 :1,转为用于 LLaMAFactory 的 Alpaca 格式数据

采用5090

vscode连接远程服务器

git clone --depth 1 https://github.com/hiyouga/LLaMA-Factory.git

cd LLaMA-Factory

mkdir -p /root/autodl-tmp/conda/pkgs

conda config --add pkgs_dirs /root/autodl-tmp/conda/pkgs

mkdir -p /root/autodl-tmp/conda/envs

conda config --add envs_dirs /root/autodl-tmp/conda/envs

conda create -n llama-factory python=3.12

conda activate llama-factory

# 报错就刷新

source ~/.bashrc

pip install -e ".[torch,metrics]"

llamafactory-cli version

llamafactory-cli webui从 HuggingFace 上下载基座模型

mkdir Hugging-Face

export HF_ENDPOINT=https://hf-mirror.com

export HF_HOME=/root/autodl-tmp/Hugging-Face

echo $HF_ENDPOINT echo $HF_HOME

pip install -U huggingface_hub

hf download Qwen/Qwen2.5-7B-Instruct选择模型Qwen2.5-7B-Instruct

因为:

- 是 instruction-tuned 模型

- 支持 29+ 语言,包含中文

- 支持很长上下文

- 对 结构化输出(尤其 JSON) 做了增强描述。

Qwen3-8B 官方模型卡的亮点是:

- 支持 thinking / non-thinking 两种模式切换

- 在数学、代码、逻辑推理上更强。

但是任务是商品文案生成,训练快成本低。

三、微调过程

四、部署验证

五、问题总结

- THE END -

最后修改:2026年4月18日

共有 0 条评论