开源Agent之王(近期三个月内) Hermes

学习方式:Self-Improving Loop

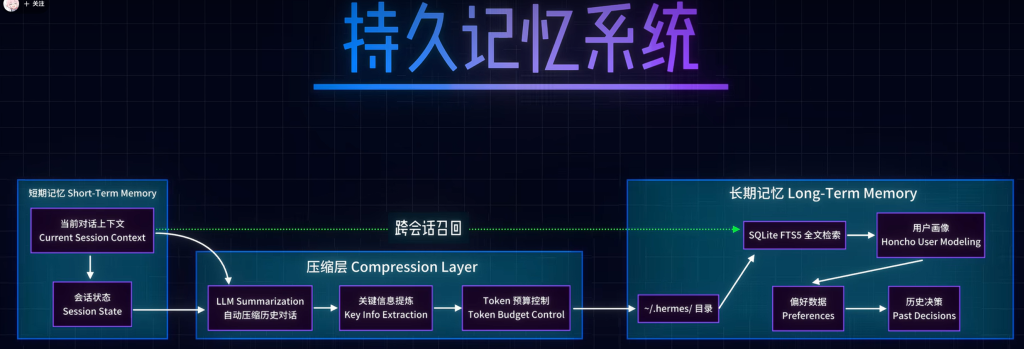

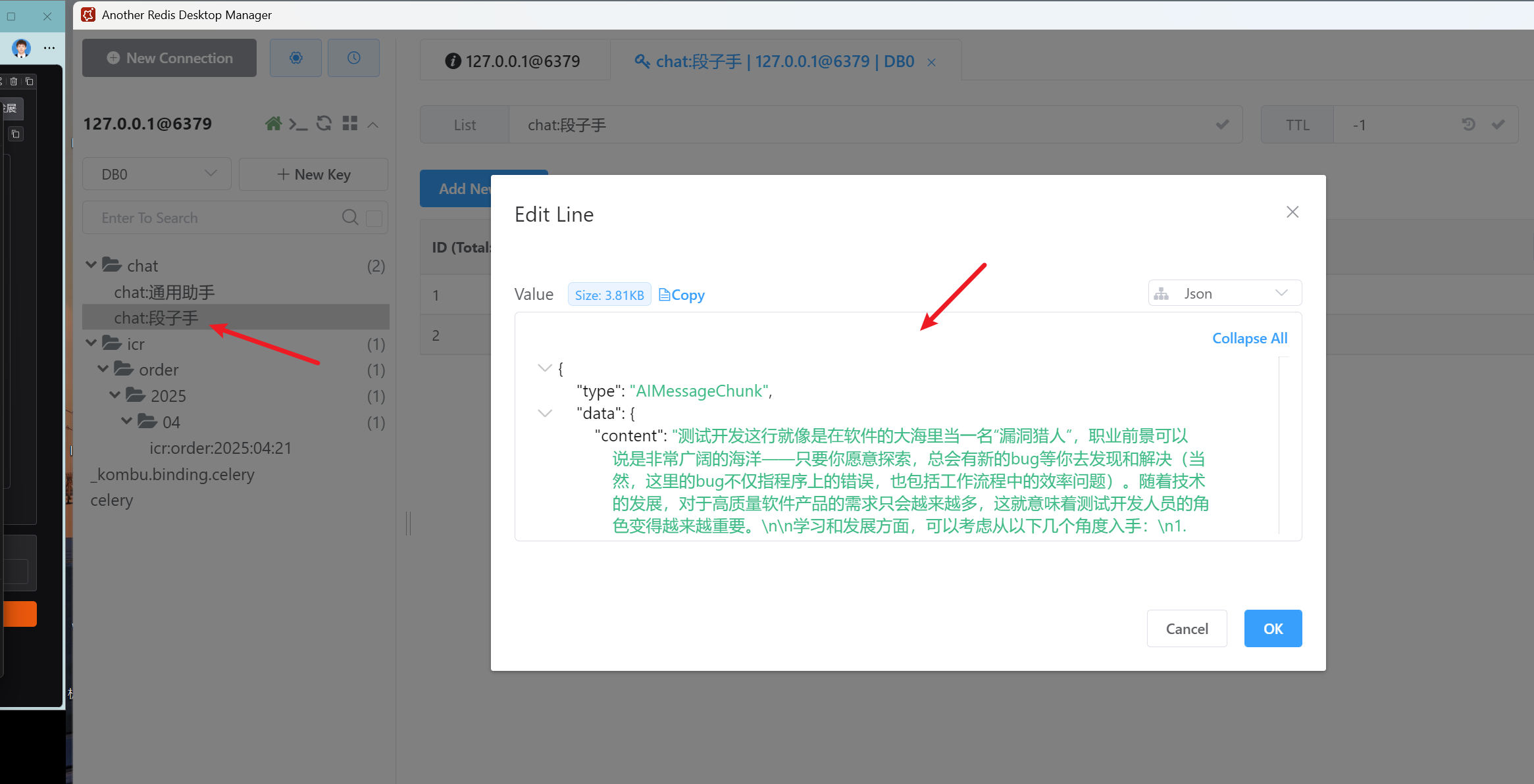

第一层:记忆积累 Memory Accumulation

用户偏好 -> 项目背景 -> 工作风格 -> 常用工具 -> 跨会话记忆

完成任务后出发第二层:

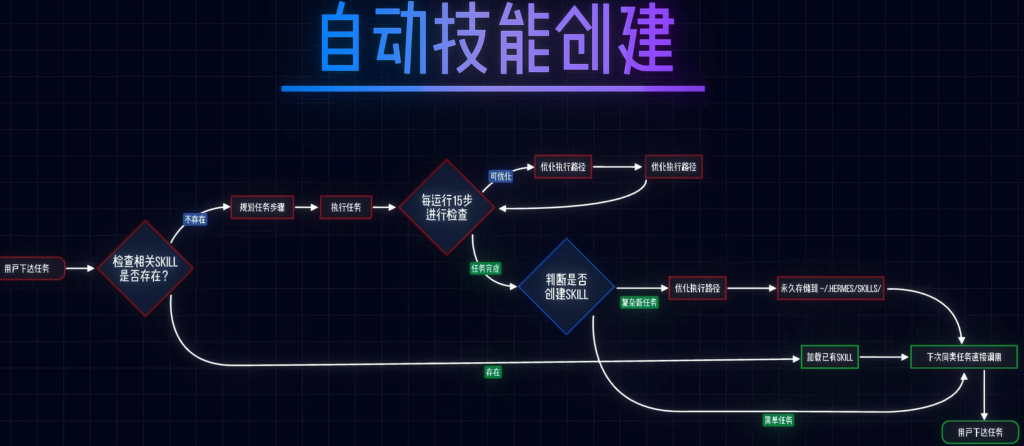

第二层: 技能生成 Slill Generation

复杂任务触发 -> 每15步自检 -> 提炼流程成SKILL.md -> 永久存储 -> 下次同类任务直接调用

记忆+技能积累到第三层

第三层:持续进化 Continuous Evolution

技能融合 -> 执行步骤优化 -> 偏好深度对齐 -> 越跑越顺

场景选择

- THE END -

最后修改:2026年5月8日

非特殊说明,本博所有文章均为博主原创。

如若转载,请注明出处:https://blog.grover.top/2026/05/08/%e5%ad%a6%e4%b9%a0hermes-agent/

共有 0 条评论